开云官方体育app 云巨头为什么越来越不思只买英伟达了

往时两年,AI 基础样式最直不雅的叙事是:谁能拿到更多英伟达 GPU,谁就能跑得更快。

这句话到今天依然树立。但问题也越来越了了——头部云厂商依然不骄矜于只作念“买卡的东谈主”了。

Google 最近把与 Broadcom 的定制 AI 芯片联结签到了 2031 年;Anthropic 还将从 2027 年开动取得自便 3.5 吉瓦、基于 Google AI 惩办器的算力。险些团结时候,Uber 也布告把一部分业务研讨和 AI 模子考验放到 AWS 的 Graviton 与 Trainium 上。把这些信号放在全部看,你会发现一个越来越剖释的趋势:Google、AWS、Microsoft、Meta 这些平台型公司,正在一边连续拥抱英伟达,一边加快把自研芯片作念成我方的第二条主航谈。

淌若只把这件事长入成“去英伟达化”,就看浅了。真实发生的,是云厂商正在把 AI 期间最中枢的分娩尊府——算力——从外部采购品,从头变成我方不错界说、不错优化、也不错议价的里面能力。

中枢判断

第一,自研芯片不是为了坐窝替代英伟达,而是为了幸免被单一供应商界说全部利润结构。第二,着手被自研芯片拿下的,不是总共责任负载,而是那些可圭臬化、可肖似、可范围化的考验与推理任务。第三,真实决定输赢的,不再是单颗芯片的参数对比,而是芯片、收罗、散热、调节、框架与客户workload 的系统级协同。

一|云巨头为什么越来越不肯意“只买英伟达”了?

先把一个前提说了了:英伟达依然是今天AI 基础样式里最强、最通用、最锻练的那套采纳。不管是模子考验、复杂推理,如故面临海量外部客户的通用算力供给,英伟达的生态、器用链和兼容性,短期内皆很难被绝对替代。

但也正因为如斯,任何一家头部云厂商皆不会称心把我方的改日总共交给单一供应商。

原因并不复杂。第一,老本压力会越来越重。市集之是以追赶定制芯片,一个很试验的原因即是要寻找高价GPU 以外的替代旅途。第二,供接收路子图会被外部厂商牵着走。关于超大范围云厂商来说,最中枢的基础样式淌若总共建设在别东谈主界说的节拍上,政策上自然是不惬意的。第三,互异化会被减弱。淌若总共东谈主皆买团结套芯片、跑团结套软件栈、卖团结类实例,云厂商最终更像“转售商”,而不是平台界说者。

是以再看Google 与 Broadcom 把联结拉长到 2031 年,这件事就不仅仅“买几代芯片”的问题了。它更像是一次耐久产能、耐久架构、耐久就业能力的绑定。Broadcom 不仅仅为 Google 供货,而是在参与 Google 下一代 AI 机架与 TPU 路子的共同计划。

Uber 使用 AWS 自研芯片亦然一样的逻辑。Uber 不是不知谈英伟达强,而是在更试验地作念采用:并不是总共 workload 皆需要最通用、最顶格的 GPU。关于一部分业务来说,更好的价钱性能比、更多的资源可得性,以及更逼近云平台自身就业体系的器用链,反而更蹙迫。

说得更直白一丝:在AI 期间,云巨头不思耐久作念“英伟达的二级经销商”。

二|自研芯片着手吃掉的,不是全部算力,而是“平定的大单”

许多东谈主一看到Google TPU、AWS Trainium、Azure Maia,就会自动联思到一个论断:它们是不是要全面替代 GPU?

谜底恰恰不是。

自研芯片最强的场所,不在于它一上来就能把总共场景皆打穿;它真实擅长的,是先把那些敷裕大、敷裕平定、敷裕肖似、敷裕容易作念软硬协同优化的责任负载吃下来。

Google 的旅途就很典型。Google Cloud 明确说过,像 Gemini、Veo、Imagen 这么的前沿模子,考验和就业皆建设在 TPU 之上。Google 真实思作念的,不是单纯卖一块芯片,而是把 TPU、收罗、调节、软件框架和摧毁模子全部打包进 AI Hypercomputer 这套体系里。换句话说,Google 卖的名义上是 TPU,本色上卖的是一整套可范围复制的 AI 基础样式行径论。

AWS 的旅途也一样剖释。AWS 官方给出的说法很是径直:Trainium2 对比 GPU 型 EC2 P5e、P5en 实例,不错作念到 30%—40% 更好的价钱性能比;它又通过 NeuronLink、EFA 收罗和 Neuron SDK,把芯片、就业器、集群与诱惑体验连成了一体。对云厂商来说,这意味着只须某类考验或推理任务敷裕平定,就有契机把正本依赖外部 GPU 的老本结构,冉冉挪动到我方可控的栈上。

Meta 的 MTIA 进一步确认了这条路子最合乎什么场景。Meta 我方说得很率直:MTIA 主要优化的是排序与保举推理,何况依然在数据中心里大范围部署。也即是说,自研芯片并不是先去挑战最难、最通用、变化最快的总共任务,而是优先去吃下那些最容易变成范围上风的里面中枢负载。

这亦然为什么Anthropic 的试验采纳很有代表性。今天的头部模子公司,并不是“全寰宇皆只剩一种芯片”的单选题,而更像是一个按照 workload 类型切分的组合寰宇:谁更合乎考验,谁更合乎推理,谁更合乎里面就业,谁更合乎对出门租,谁的器用链挪动老本更低,谁就会拿下那一部分订单。

是以,自研芯片不是从“全面替代”开动的,而是从“先拿下最平定、最值钱、最能范围化复用的那部分”开动的。

三|真实的战场不是芯片,而是“芯片 + 系统”

淌若说许多东谈主的第一层长入还停留在“Google 也有芯片,AWS 也有芯片”,开云官方体育app那么更深一层的问题是:为什么这些云巨头当今皆在强调系统级协同?

因为AI 基础样式越往后走,单颗芯片自己的蹙迫性,反而越不够讲授全部竞争力。

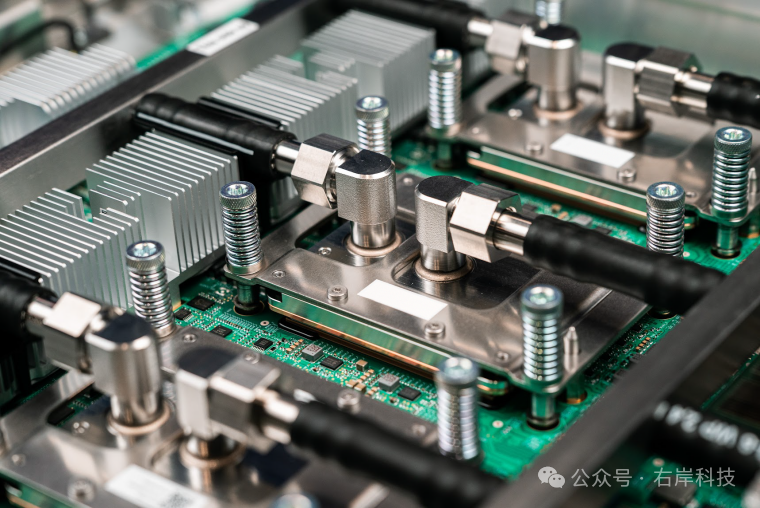

Google 在谈 Ironwood TPU 时,把话说得很是显著:Agentic workflows 的兴起,以及通用研讨与机器学习加快之间更缜密的协同需求,正在为定制硅与垂直优化系统架构创造契机。它展示的不是一颗芯片,而是一整套从板卡、液冷、机架、光互连、调节到数据中心收罗的系统。按照 Google 的说法,Ironwood 最多不错在一个 superpod 里径直说合 9,216 颗 TPU,再通过更大的数据中心收罗彭胀到数十万颗芯片级别的集群。

AWS 亦然一样。Trainium2 的价值,并不单在芯片自己,而在于它被放进了 Trn2 实例、Trn2 UltraServers、EC2 UltraClusters、EFA 收罗和 Neuron 软件栈这整条链路里。官方材料暴露,Trn2 UltraServers 不错把 64 颗 Trainium2 芯片通过 NeuronLink 连成一个系统,提供最高 83.2 petaflops 的 FP8 算力。这个时候你就会显著:云厂商真实思界说的,不是一块芯片,而是一种把芯片变成云就业的能力。

图3|Google 展示的 Ironwood 板级与液冷/系统计划。定制芯片的竞争,越来越是系统工程竞争。图源:Google Cloud

Microsoft 对 Maia 的表述也很有代表性。它不是把 Maia 说成“一颗自研 AI 芯片”,而是明确把这条路子笼统为“from silicon to software to systems”。从芯片封装、机架级供电、闭环液冷,到 PyTorch、ONNX Runtime 这类软件适配,微软强调的是整套链路的共同演进。有趣很是了了:在 AI 期间,单点参数逾越不够,系统举座恶果、举座老本和举座可用性,才是决定平台竞争力的错误。

这背后还有一个更容易被忽略的变化:软件挪动门槛正在被刻意作念低。

Google 在 PyTorch/XLA 2.5 中提到,诱惑者依然不错用实验性的 vLLM on TPU,何况把已有 vLLM endpoint 切到 TPU,只需要作念少许竖立变更;AWS 则强调 Neuron 对 PyTorch、JAX 以及 Hugging Face 等生态的原生复古。为什么这件事蹙迫?因为自研芯片真实难的,从来不是流片见效,而是能不可让路发者用起来不不幸、让客户挪动老本敷裕低、让就业团队大范围录用时不出问题。

谁能把“硬件能力”真实作念成“就业能力”,谁才有契机把自研芯片变成一条耐久营业。

四|这不是“英伟达失势”,而是云厂商在搭建“双制度”

最容易犯的错,即是把这轮自研芯片潮长入成“英伟达要不行了”。

试验刚好违反。

Google 一边激动 TPU 和 AI Hypercomputer,一边又在 2026 年 GTC 工夫连续扩大与 NVIDIA 的联结,彭胀 G4 VM、分片 GPU、以及后续对 Vera Rubin NVL72 的复古。AWS 亦然团结套逻辑:它在激动 Trainium 的同期,依然推出了基于 NVIDIA GB200 NVL72 的 P6e-GB200 UltraServers,而且明确把它界说为 EC2 中最高 GPU 性能的实例采纳。

图4|Amazon EC2 Trn2 就业器 sled。云厂商真实要卖的,不是一颗芯片,而是一条可复制的就业能力链路。图源:Amazon Web Services

这确认什么?确认云巨头真实追求的,不是“把英伟达踢出去”,而是建设一套双制度。

一条轨谈,连续拥抱英伟达。因为它依然代表最锻练的通用生态、最粗俗的客户兼容性,以及面上前沿模子、洞开市集和复杂实验的最高机动度。

另一条轨谈,则是把自研芯片作念深。让它承担那些范围敷裕大、需求敷裕笃定、老本敷裕明锐、而且概况通过软硬协同不停压缩单元经济老本的任务。

唯有把这两条轨谈同期跑通,云厂商才不会在AI 期间被动二选一。

是以,Google、AWS、Microsoft、Meta 当下作念的,其实不是一次“背离英伟达”的算作,而是在为我方争取更大的回旋空间:对上,不错培植与芯片供应商谈判时的主动权;对下,不错把不同客户、不同模子、不同任务的需求,分拨到最合适的基础样式栈里。

五|终末:云厂商思要的,不仅仅芯片,而是AI 期间的界说权

淌若把时候再往前拨十几年,云研讨期间最蹙迫的事,是把CPU、存储、收罗诬捏化,然后以更机动的阵势卖出去。

而到了AI 期间,事情变了。

云厂商不再骄矜于只提供“别东谈主发明好的算力”。它们思要的是从芯片,到机架,到收罗,到调节,到框架,再到客户 workload 的整套界说权。因为唯有掌合手这套界说权,才能真实决定老本结构、就业形态、录用恶果和利润分拨。

这亦然为什么今天看起来像是一场“芯片竞赛”的事,本色上越来越像一场基础样式工业能力竞赛。

英伟达虽然还会连续强,而且短期内依然强得惊东谈主。但真偶合得关怀的变化,依然不是“谁能替代英伟达”,而是云巨头依然不肯意只作念英伟达的客户了。

它们要作念的,是在连续购买英伟达的同期,把我方也变成AI 期间的芯片玩家、系统玩家、平台玩家。

这才是这轮自研芯片潮最蹙迫的底层逻辑开云官方体育app。

雅博体育app中国官网入口- 上一篇:开云app 小节轰下34-17! 北控灭山西闭幕4连败 豪斯25分沈梓捷两双

- 下一篇:没有了

备案号:

备案号: